Перший закон про ШІ в ЄС: що під забороною та які штрафи передбачені

Для власників таких моделей ШІ як ChatGPT та Gemini також передбачені додаткові зобов'язання

Для власників таких моделей ШІ як ChatGPT та Gemini також передбачені додаткові зобов'язанняФото: Unsplash

Зараз компанії, які займаються розвитком технологій штучного інтелекту (ШІ), діють в умовах загальної конкуренції, яку неможливо регулювати. У цих перегонах дискусії про небезпеку, прозорість та інтелектуальну власність залишаються осторонь.

Про це розповіло видання ThePage.

Огляд Вартість роботи з ChatGPT: які ціни на тарифні плани чат-боту

Економіка

Про ChatGPT забудуть всі? Маск анонсував створення нового конкурента ШІ

БізнесПроте з 1 серпня в ЄС набув чинності закон, який регулює ШІ. Він дає компаніям достатньо часу для дотримання його норм. Більшість регламентів з нього набудуть чинності лише за 2 роки. Також його нормативні концепції можуть знайти застосування й у США, як на федеральному рівні, так і на рівні штатів.

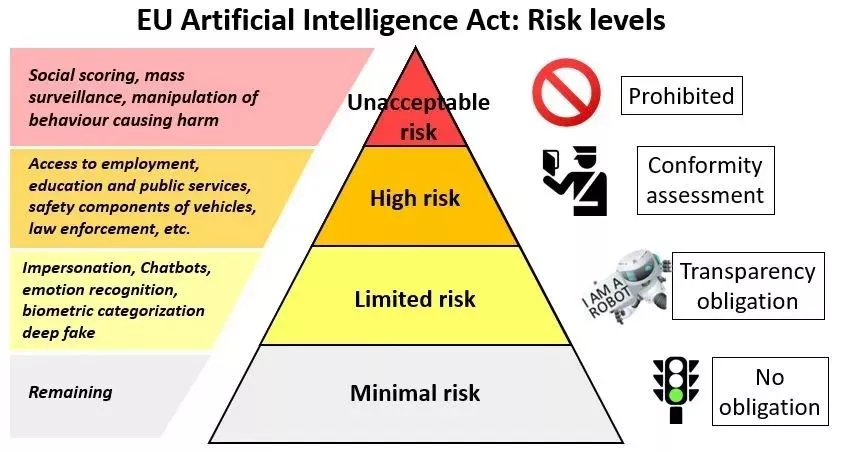

На які класифікації розділяються системи ШІ залежно від загрози ризику

Основною метою нового закону є класифікація систем ШІ залежно від ризиків, які вони можуть нести для людей.

Неприйнятний ризик

Ця категорія охоплює системи, які категорично заборонені законом через їх шкідливий вплив. До них входять:

- нецільові бази даних розпізнавання облич, які відстежують людей в інтернеті або через громадські камери відеоспостереження;

- соціальний скоринг, що оцінює людей на основі їхньої поведінки або особистих якостей;

- маніпулятивні прийоми (або "темні патерни"), які обманом змушують людей здійснювати небажані дії;

- системи оцінки ризику, що прогнозують ймовірність скоєння злочину чи можливості звільнення під заставу.

Високий ризик

Такі системи підлягають суворому регулюванню, оскільки вони мають вплив на важливі рішення, що безпосередньо торкаються життя людей. Серед них системи:

- біометричної ідентифікації;

- критично важливої інфраструктури (інтернет-мережі, електромережі тощо);

- освіти (оцінка успішності, моніторинг поведінки тощо);

- зайнятості (відбір резюме, моніторинг співробітників);

- державних та фінансових послуг (оцінка кредитоспроможності, алгоритми ціноутворення);

- забезпечення правопорядку (прогнозування злочинів, кримінальне профілювання);

- обробки імміграційних заяв;

- демократичних процесів (судові рішення, вибори).

Обмежений ризик

До цієї категорії належать такі системи ШІ, як ChatGPT або Midjourney, які займаються генеруванням контенту. До їх зобов'язань додається:

- інформувати користувачів, що вони взаємодіють з ШІ;

- маркувати контент, створений ШІ, для чіткого розрізнення його від людського.

Мінімальний ризик

Такі системи не підлягають регулюванню і включають, наприклад, спам-фільтри та ШІ у відеоіграх.

Класифікація ШІ за ризиками. Фото: Скриншот

Класифікація ШІ за ризиками. Фото: СкриншотВимоги до систем ШІ загального призначення

Новий закон також регулює системи ШІ загального призначення. До таких відносяться GPT-4 від OpenAI або Gemini від Google.

Розробники подібних моделей повинні:

- дотримуватися авторських прав ЄС;

- надавати звіти про контент, використаний для навчання;

- публікувати технічну документацію та надавати її користувачам, які інтегрують ці моделі у власні продукти.

Які штрафи за порушення закону

За порушення положень нового законодавства передбачено значні штрафи. Вони досягають 35 млн євро або 7% річного глобального доходу компанії. Сума залежить від того, що більше.

Компанії, які мають пряме відношення до систем ШІ, вже висловили підтримку новим правилам. Представництво компанії Meta зазначило, що нові правила ЄС допоможуть забезпечити відповідальність при розробці та впровадженні систем ШІ.

"Ми вітаємо гармонізовані правила ЄС, які гарантують відповідальну розробку та впровадження ШІ. З самого початку ми підтримували заснований на ризиках, нейтральний щодо технологій підхід Єврокомісії та відстоювали необхідність у структурі, яка сприяє та заохочує відкриті моделі ШІ та відкритість у ширшому сенсі", – зазначили у компанії.

Також вони наголосили на важливості прозорості для стимулювання інновацій.

OpenAI також підтримала нове регулювання.

"OpenAI прагне дотримуватися Закону ЄС про ШІ, і ми тісно співпрацюватимемо з новим Управлінням ЄС з ШІ у міру впровадження закону. Найближчими місяцями ми продовжимо підготовку технічної документації та інших посібників для постачальників і розробників наших моделей GPAI, одночасно підвищуючи безпеку та захищеність моделей, які ми надаємо на європейському ринку і за його межами", – зазначили у представництві.

Такі дії допоможуть одночасно підвищувати безпеку та захищеність своїх моделей ШІ.

Раніше ми розповідали про те, що ховається під маскою безпеки темних сторінок Telegram. Також ми писали про те, в чому перевага дронів зі штучним інтелектом.

Україна зі світлом – яка ситуація з енергопостачанням 6 серпня